Systematisch verzerrt

Denkfehler

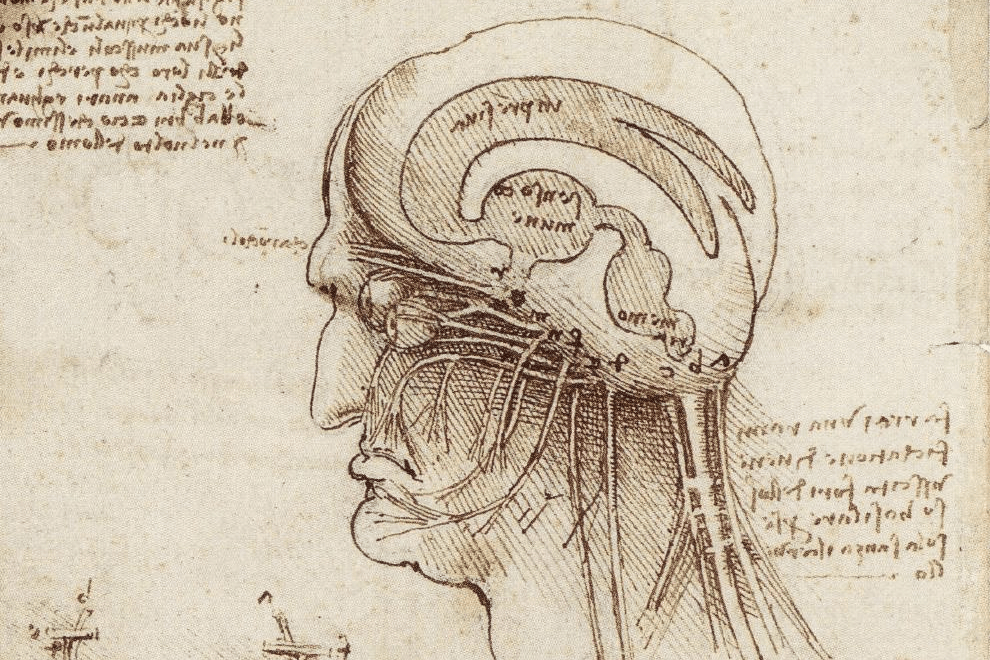

Denken ist anstrengend. Knapp 20 % der Gesamtenergie, die wir unserem Körper zuführen, geht an das Gehirn. Und, weil Denken so verdammt energieintensiv ist, hat das Gehirn einen Energiesparmodus, in dem es sich nicht ganz so sehr anstrengen muss. Diesen Energiesparmodus nennt Daniel Kahneman in seinem Buch “Thinking Fast and Slow”, System 1. Dieses System 1 ist verdammt schnell und arbeitet automatisch. Immer wenn wir das Gefühl haben, gar nicht zu denken, ist System 1 am Drücker, z.B. beim Gehen oder Atmen. Auf der anderen Seite steht das System 2. Es ist sehr viel langsamer, aber dafür genauer. Es kommt dann zum Einsatz, wenn wir richtig nachdenken müssen.

Leider ist unser Gehirn nicht immer ganz zielsicher, wenn es darum geht, das angemessene System für eine Aufgabe zu wählen. Das klassischste Beispiel dafür ist das folgende: Ein Baseball und ein Schläger kosten zusammen 11 €. Der Schläger ist 10 € teurer als der Ball. Wie teuer ist der Ball? Klar, die intuitive Antwort, die sich einem aufdrängt, ist: 1 €.

Wenn man aber kurz nachrechnet, merkt man, dass man falsch liegt (1 €[Ball] + 11 €[Schläger] = 12 €). Offensichtlich, hat hier System 1 eine vorschnelle Entscheidung getroffen. Ohne unser Zutun und ohne, dass wir es gleich gemerkt hätten.

Aus diesem Zusammenspiel zwischen System 1 und 2 entstehen einige systematische Denkfehler. Richard Thaler und Cass Sunstein bauen in ihrem Buch “Nudge” genau auf diesen Fehlern auf und zeigen, welche Effekte sie auf Entscheidungen haben. Vor allem zeigen sie aber auch, wie man diese Effekte nutzen kann, um Menschen in Richtung einer guten Entscheidung zu nudgen (engl. stupsen).

Unabhängig von Nudges finde ich es wichtig, diese systematischen Denkfehler zu kennen. Nur dann kann man sie nämlich bei sich selbst diagnostizieren und bewusst System 2 einschalten.

Der Anker Effekt

Anker beeinflussen unsere Einschätzung. Das geschieht unbewusst; die Einschätzung wird systematisch in Richtung des Ankers verzerrt.

Soll man zum Beispiel die Einwohnerzahl einer Stadt schätzen, wäre die Größe der eigenen Heimatstadt ein solcher Anker. Man nutzt diese bekannte Zahl und passt sie dann nach oben oder unten an, das nennt man dann auch Anpassungsheuristik. Für eine solche Schätzung ist ein Anker praktisch. Anker haben allerdings auch dann einen Einfluss auf uns, wenn wir den Anker nicht selber wählen.

Ein Beispiel dafür ist die unverbindliche Preisempfehlung (UVP). Diese ist fast immer höher als der tatsächliche Preis. Die UVP ist ein Anker, der dafür sorgt, dass wir uns mit einem Kauf gut fühlen. Wir haben ja schließlich etwas gekauft, das eigentlich mehr Wert ist.

Andere Beispiele für Anker sind:

- Die erste Gehaltsvorstellung bei der Gehaltsverhandlung.

- Die “empfohlenen” Spendenbeträge bei Wikipedia.

Übrigens, Kahneman hat in seiner Forschung herausgefunden, dass Anker sogar dann wirken, wenn sie gar keinen Bezug zu einer bestimmten Größe haben. So hat man Probanden zuerst die letzten drei Ziffern ihrer Telefonnummer sagen lassen, danach mussten sie ein geschichtliches Ereignis datieren. Und siehe da, die geschätzten Jahreszahlen waren systematisch in Richtung der Telefonnummern verzerrt. Erstaunlich.

Verfügbarkeit

Wir schätzen die Wahrscheinlichkeit von Ereignissen eher danach ein, wie gut wir uns an das Auftreten eines solchen Ereignisses erinnern können, als nach der tatsächlichen Häufigkeit.

Man kennt das, kurz nach einem Flugzeugabsturz, der groß in den Medien besprochen wurde, hat man plötzlich ein mulmiges Gefühl, wenn man in den Flieger steigt. Angst bei einem Hundeangriff zu sterben, hat man allerdings fast nie. Dabei ist die Wahrscheinlichkeit für den Hundeangriff laut der Allianzversicherung tatsächlich höher (1 zu 188.364 beim Flugzeug vs. 1 zu 115.111 beim Hund). Viel wichtiger ist aber natürlich der Unterschied zwischen dem Gefühl vor und nach der Berichterstattung über den Flugzeugabsturz. Die tatsächliche Gefahr hat sich nicht geändert, unser Gefühl schon.

Diesen Effekt kann man natürlich auch an vielen anderen Stellen beobachten. Zum Beispiel bei der Gefährlichkeit von Krankheiten, Terrorismus oder IT-Sicherheits-Risiken.

Repräsentanz

Wir überschätzen die Aussagekraft von kleinen/nicht repräsentativen Stichproben.

Hat man eine realistische Chance, Influencer zu werden (mal angenommen man will das)? Ein Blick in die sozialen Medien offenbart eine Flut an Influencern aller Art. Bei solch einer Fülle scheint dies also so schwer nicht zu sein.

Natürlich unterliegt man hier einem schweren Selection Bias. Man nimmt schließlich nur die Influencer wahr, die es auch tatsächlich zu solchen geschafft haben. Wir halten unsere Wahrnehmung also zu schnell für repräsentativ. Hier spielt dann natürlich auch die Verfügbarkeit mit rein. Rein intuitiv halten viele ihren Lebensentwurf und -stil deshalb für repräsentativ.

Lustig ist, dass selbst Statistik Professoren vor diesem Effekt nicht gefeit sind. Als Kahneman seine Kollegen schätzen ließ, wie hoch die Scheidungsrate bei Eheleuten sei, fingen sie alle an, an ihre Freunde, Familie und Verwandte zu denken, um auf dieser Basis eine Schätzung abzugeben. Natürlich ist das eigene soziale Umfeld aber so gar nicht repräsentativ, schon gar nicht das von Statistikern.

Selbstüberschätzung

Wir überschätzen unsere Fähigkeiten und unser Glück.

Neunzig Prozent der Autofahrer halten sich für überdurchschnittlich gut (ich gehöre nicht dazu). Gleichzeitig unterschätzen Kettenraucher die eigene Wahrscheinlichkeit, Lungenkrebs zu bekommen, und das, selbst wenn sie die statistischen Risiken kennen. Menschen scheinen einen tiefen intrinsischen Optimismus zu haben. Der Mensch denkt, er kann sich immer noch irgendwie durchwurschteln. Mit Blick auf das Klima, bleibt nur zu hoffen, dass uns das nicht zum Verhängnis wird.

Verlustaversion

Im Schnitt trifft uns ein Verlust doppelt so hart, wie ein gleichwertiger Gewinn.

Experimentell lässt sich das gut zeigen. Dafür bietet man Probanden eine Wette an, bei der sie eine Münze werfen können. Werfen sie Kopf, erhalten sie eine Auszahlung von 1 €. Bei Zahl verlieren sie 100 €. Eine solche Wette lehnt natürlich jeder ab. Jetzt erhöht man den einen Euro in kleinen Schritten, solange, bis der Proband die Wette annimmt. Im Schnitt passiert das bei rund 200 €. Das bedeutet, dass Situationen, in denen wir etwas verlieren können, uns notorisch schlechter erscheinen, als sie es wirklich für uns sind. Rational wäre es gewesen, die Wette bei 101 € anzunehmen.

Die Verlustaversion erklärt auch, warum z.B. Steuererhöhung oder Geschwindigkeitsbegrenzungen so unpopulär sind. Die positiven Effekte dieser Maßnahmen müssen die Einschränkungen nämlich doppelt ausgleichen. Der Effekt wird natürlich stärker, wenn ein möglicher Gewinn nur schwer greifbar oder quantifizierbar ist.

Hang zum Status-Quo

Es fällt uns unverhältnismäßig schwer, den Status-Quo zu ändern.

Wer schon mal ein Jahresabo der Zeit (ich meine die Zeitung) verlängert hat, einfach, weil man nicht zum Kündigen gekommen ist, oder wer nervige Newsletter bekommt, die man mit einem Klick abbestellen könnte, ist mit dem Hang zum Status-Quo gut vertraut.

Er führt zu dem schönen Satz: “Das haben wir schon immer so gemacht.” und dazu, dass Nutzerinnen über Jahrzehnte hinweg, den Internet Explorer genutzt haben. Er erklärt, warum Standardeinstellungen so mächtig sind und warum Google jedes Jahr zwischen 8 und 12 Milliarden US-Dollar an Apple zahlt 2, nur damit es die Standardsuchmaschine auf allen Apple Geräten ist.

Problematisch ist der Hang zum Status-Quo dann, wenn eine Änderung wirklich notwendig ist. Dann muss man nämlich nicht nur die Arbeit leisten, die diese Änderung an sich mitbringt, sondern man muss auch noch mentalen Barrieren überwinden.

Framing

Umformulierungen von identischem Inhalt hat einen Einfluss darauf, wie dieser Inhalt aufgenommen wird.

“Das Desinfektionsmittel entfernt 99,9 % aller schädlichen Viren und Bakterien” hört sich eindeutig viel besser an als “Das Desinfektionsmittel lässt 0,1 % der schädlichen Viren und Bakterien unbeschadet zurück.” Vielleicht muss man also manchmal Aussagen auf diese Art umdrehen und diese dann prüfen.

Für diesen Fall finde ich es vollkommen ok, dass 0,1 % aller Bakterien und Viren überleben. Ich kann mich also beruhigt für das entsprechende Desinfektionsmittel entscheiden. Vor allem deshalb, weil ich weiß, dass meine Entscheidung eben nicht an blumigen Worten liegt. Von solchen lassen wir uns nämlich recht schnell austricksen.

Viele der obigen Beispiele waren den meisten bestimmt schon bekannt oder wirken jedenfalls sehr einleuchtend. Entscheidend ist aber nicht, die Beispiele zu kennen, sondern die Effekte benennen zu können. Nur wenn man weiß, dass ein Fehler ein Fehler ist, kann man ihn nämlich erkennen.

Ist ein Blick wert!

Wirklich. Mehr gibt es dazu nicht zu sagen.

Satzfetzen

Ein Buch ist voller Sätze, manche sind es wert hervorgehoben zu werden.

»Er war Anfang Zwanzig, und sein Lebenswerk war getan. Er wusste: Wie lange er auch noch da sein würde, er könnte nichts Vergleichbares mehr zustande bringen.«

— aus “Die Vermessung der Welt” von Daniel Kehlmann

Ein GIF für alle Fälle

Wer kennt es nicht: Ganz plötzlich braucht man ein GIF, hat aber gerade keins zur Stelle.

Designed & Developed by Jasper Anders